불법 영상 콕 집어 삭제… AI가 ‘n번방’의 눈물 닦아줄까

고재원 동아사이언스 기자

입력 2020-04-06 03:00 수정 2020-04-06 03:00

여성을 협박해 성 착취물을 찍게 하고 이를 인터넷 메신저 ‘텔레그램’에 공유해 부당이득을 취한 ‘n번방’ 사건 파장이 커지고 있다. 확인된 피해자가 74명에 달하고 절반 이상이 중학생 등 미성년자였다는 사실이 밝혀지며 사회적 분노가 커지고 있다. 가해자에 대한 철저한 수사와 처벌 못지않게, 씻을 수 없는 상처를 입은 피해자들의 영상이 더 이상 유포되지 않도록 막는 기술이 절실해졌다.

여성가족부 산하 한국여성인권진흥원은 2018년 4월부터 성범죄 불법 촬영물 삭제를 지원하는 ‘디지털 성범죄 피해자 지원센터’를 운영 중이다. 피해자가 센터에 신고하면 촬영물이 게시된 웹사이트나 플랫폼은 센터가 파악해 직접 삭제를 요청하는 방식이다. 센터는 현재 n번방 피해자 40명의 영상물 삭제를 지원하고 있다.

하지만 이런 방식으로는 불법 촬영물 유포를 막기 어렵다. 인터넷의 특성상 불법 촬영물이 여러 플랫폼과 웹사이트에서 걷잡을 수 없이 퍼져 나가는데 이를 삭제하려면 직접 확인하고 요청하는 데 시간이 소요되기 때문이다.

이남경 한국전자통신연구원(ETRI) 미디어연구본부 책임연구원은 “인력에 의존해 불법 촬영물 유포를 막는 것은 거의 불가능하다”며 “인공지능(AI)을 활용한 기술로 대체할 수 있다”고 말했다. 과학기술정보통신부와 여성가족부는 지난해 7월 AI를 적용한 ‘불법 촬영물 삭제 지원 시스템’을 시험 적용한 뒤 11월부터 활용하고 있다.

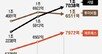

ETRI가 개발한 이 시스템은 피해자가 신고한 불법 촬영물에서 이미지를 추출한다. 추출된 이미지의 특성을 분석해 웹하드 사이트에 등록된 영상물 중 불법 촬영물과 유사한 영상물을 AI가 자동으로 선별하고 수집한다. 지난해 하반기(7∼12월) 42개 웹하드 사이트에 대한 검색 기능을 확보했다. 사람이 직접 영상물을 골라내지 않아도 24시간 자동 검색이 가능하다. 다만, 찾아낸 불법 촬영물을 페이스북 등 플랫폼 사업자에게 신고하는 것은 사람이 해야 한다.

해외에서는 불법 촬영물 유포를 막기 위해 일찌감치 AI 기술을 활용하고 있다. 페이스북은 지난해 3월 AI를 이용해 디지털 성범죄물의 선제적 차단에 나선다고 밝혔다. 기존에는 피해자가 먼저 사진이나 영상을 발견해 신고해야 페이스북이 이를 분석한 후 차단하는 방식이었다. 이와 달리 페이스북이 지난해 도입한 AI 기술은 피해자를 포함한 누군가가 불법 촬영물을 신고하지 않아도 알몸 노출 상태인 사진이나 영상을 미리 검열한다.

마이크로소프트는 AI 기술이 보편화되기 전인 2009년 ‘포토DNA’라는 기술을 개발했다. 포토DNA는 불법 촬영물에서 특정한 디지털 정보를 뽑아내 만든 정보다. 손가락에서 지문을 채취하는 것처럼 불법 촬영물에서 특정한 디지털 정보를 뽑아내는 것이다. 그런 뒤 이 정보를 온라인상에 존재하는 다른 촬영물과 대조해 불법 촬영물을 식별한다. 2016년 12월 페이스북과 트위터, 구글도 이 기술을 사용하겠다는 계획을 발표했다. 마이크로소프트는 2018년 9월부터 포토DNA 기술을 무료로 제공하고 있다.

불법 촬영물 유포를 막기 위한 아이디어들도 구체화하고 있다. 지난해 과기정통부는 ‘디지털 성범죄 피해 방지 아이디어 및 R&D 기획 공모전’을 진행했다. 당시 AI 기술 외에 3차원(3D) 신체 모델링 기술을 더해 얼굴 분간이 힘든 불법 성범죄 영상을 걸러내는 아이디어가 제시됐다. 과기정통부 관계자는 “지난해 하반기 신규 연구개발 과제로 기획해 3년간 총 20억 원 규모로 추진 중”이라며 “현재는 개발 초기 단계”라고 밝혔다.

고재원 동아사이언스 기자 jawon1212@donga.com

여성가족부 산하 한국여성인권진흥원은 2018년 4월부터 성범죄 불법 촬영물 삭제를 지원하는 ‘디지털 성범죄 피해자 지원센터’를 운영 중이다. 피해자가 센터에 신고하면 촬영물이 게시된 웹사이트나 플랫폼은 센터가 파악해 직접 삭제를 요청하는 방식이다. 센터는 현재 n번방 피해자 40명의 영상물 삭제를 지원하고 있다.

하지만 이런 방식으로는 불법 촬영물 유포를 막기 어렵다. 인터넷의 특성상 불법 촬영물이 여러 플랫폼과 웹사이트에서 걷잡을 수 없이 퍼져 나가는데 이를 삭제하려면 직접 확인하고 요청하는 데 시간이 소요되기 때문이다.

이남경 한국전자통신연구원(ETRI) 미디어연구본부 책임연구원은 “인력에 의존해 불법 촬영물 유포를 막는 것은 거의 불가능하다”며 “인공지능(AI)을 활용한 기술로 대체할 수 있다”고 말했다. 과학기술정보통신부와 여성가족부는 지난해 7월 AI를 적용한 ‘불법 촬영물 삭제 지원 시스템’을 시험 적용한 뒤 11월부터 활용하고 있다.

ETRI가 개발한 이 시스템은 피해자가 신고한 불법 촬영물에서 이미지를 추출한다. 추출된 이미지의 특성을 분석해 웹하드 사이트에 등록된 영상물 중 불법 촬영물과 유사한 영상물을 AI가 자동으로 선별하고 수집한다. 지난해 하반기(7∼12월) 42개 웹하드 사이트에 대한 검색 기능을 확보했다. 사람이 직접 영상물을 골라내지 않아도 24시간 자동 검색이 가능하다. 다만, 찾아낸 불법 촬영물을 페이스북 등 플랫폼 사업자에게 신고하는 것은 사람이 해야 한다.

해외에서는 불법 촬영물 유포를 막기 위해 일찌감치 AI 기술을 활용하고 있다. 페이스북은 지난해 3월 AI를 이용해 디지털 성범죄물의 선제적 차단에 나선다고 밝혔다. 기존에는 피해자가 먼저 사진이나 영상을 발견해 신고해야 페이스북이 이를 분석한 후 차단하는 방식이었다. 이와 달리 페이스북이 지난해 도입한 AI 기술은 피해자를 포함한 누군가가 불법 촬영물을 신고하지 않아도 알몸 노출 상태인 사진이나 영상을 미리 검열한다.

마이크로소프트는 AI 기술이 보편화되기 전인 2009년 ‘포토DNA’라는 기술을 개발했다. 포토DNA는 불법 촬영물에서 특정한 디지털 정보를 뽑아내 만든 정보다. 손가락에서 지문을 채취하는 것처럼 불법 촬영물에서 특정한 디지털 정보를 뽑아내는 것이다. 그런 뒤 이 정보를 온라인상에 존재하는 다른 촬영물과 대조해 불법 촬영물을 식별한다. 2016년 12월 페이스북과 트위터, 구글도 이 기술을 사용하겠다는 계획을 발표했다. 마이크로소프트는 2018년 9월부터 포토DNA 기술을 무료로 제공하고 있다.

불법 촬영물 유포를 막기 위한 아이디어들도 구체화하고 있다. 지난해 과기정통부는 ‘디지털 성범죄 피해 방지 아이디어 및 R&D 기획 공모전’을 진행했다. 당시 AI 기술 외에 3차원(3D) 신체 모델링 기술을 더해 얼굴 분간이 힘든 불법 성범죄 영상을 걸러내는 아이디어가 제시됐다. 과기정통부 관계자는 “지난해 하반기 신규 연구개발 과제로 기획해 3년간 총 20억 원 규모로 추진 중”이라며 “현재는 개발 초기 단계”라고 밝혔다.

고재원 동아사이언스 기자 jawon1212@donga.com

비즈N 탑기사

“도박자금 마련하려고”…시험장 화장실서 답안 건넨 전직 토익 강사

“도박자금 마련하려고”…시험장 화장실서 답안 건넨 전직 토익 강사 몸 속에 거즈 5개월 방치…괄약근 수술 의사 입건

몸 속에 거즈 5개월 방치…괄약근 수술 의사 입건 일본 여행시 섭취 주의…이 제품 먹고 26명 입원

일본 여행시 섭취 주의…이 제품 먹고 26명 입원 “1인 안 받는 이유 있었네”…식탁 위 2만원 놓고 간 손님 ‘훈훈’

“1인 안 받는 이유 있었네”…식탁 위 2만원 놓고 간 손님 ‘훈훈’ 10만원짜리 사탕?…쓰레기통까지 뒤져 찾아간 커플

10만원짜리 사탕?…쓰레기통까지 뒤져 찾아간 커플- 꿀로 위장한 고농축 대마 오일…밀수범 2명 구속 송치

- 송지아·윤후, 머리 맞대고 다정 셀카…‘아빠! 어디가?’ 꼬마들 맞아? 폭풍 성장

- 한소희 올린 ‘칼 든 강아지’ 개 주인 등판…“유기견이 슈퍼스타 됐다” 자랑

- 딱 한 장만 산 복권이 1등 당첨…20년간 월 700만원

- 기존 크림빵보다 6.6배 큰 ‘크림대빵’ 인기

공사비 30% 뛰어… 멀어지는 ‘은퇴뒤 전원주택’ 꿈

공사비 30% 뛰어… 멀어지는 ‘은퇴뒤 전원주택’ 꿈 “팔겠다” vs “그 가격엔 안 사”… 아파트거래 ‘줄다리기’에 매물 月 3000건씩 ‘쑥’

“팔겠다” vs “그 가격엔 안 사”… 아파트거래 ‘줄다리기’에 매물 月 3000건씩 ‘쑥’ 명품 ‘에루샤’ 국내 매출 4조 돌파… 사회기부는 18억 그쳐

명품 ‘에루샤’ 국내 매출 4조 돌파… 사회기부는 18억 그쳐 “AI, 유럽 주방을 점령하다”… 삼성-LG 독주에 하이얼 도전장

“AI, 유럽 주방을 점령하다”… 삼성-LG 독주에 하이얼 도전장 “당하는 줄도 모르고 당한다”…SW 공급망 해킹 늘자 팔 걷은 정부

“당하는 줄도 모르고 당한다”…SW 공급망 해킹 늘자 팔 걷은 정부- 빚 못갚는 건설-부동산업체… 5대銀 ‘깡통대출’ 1년새 26% 급증

- IMF “韓, GDP 대비 정부 부채 작년 55.2%…5년뒤 60% 육박”

- 이건희, 19년전 ‘디자인 선언’한 밀라노… 삼성, 가전작품 전시회

- LH 작년 영업이익 98% 급감… 공공주택 사업까지 차질 우려

- 분식점부터 프렌치 호텔까지, 진화하는 팝업스토어